Увеличение трафика должно означать больший успех, но на практике это часто не так. На многих сайтах количество посещений растет, в то время как конверсии, вовлеченность и выручка остаются на прежнем уровне, и команды недоумевают, почему «рост» совсем не ощущается как рост.

Одна из причин заключается в том, что не весь трафик представляет собой реальных людей. Автоматизированная активность теперь составляет значительную часть современного интернета. Фактически, согласно отчету Imperva Bad Bot Report за 2025 год, автоматизированные системы составляли 51% всего веб-трафика в 2024 году, что означает, что боты в совокупности генерировали больше запросов, чем люди, впервые за десятилетие.

Когда автоматизированный трафик смешивается с аналитическими отчетами, одни только необработанные данные о количестве посещений становятся ненадежным показателем интереса или спроса со стороны аудитории.

В этой статье объясняется, как отличить настоящих посетителей сайта от полезной автоматизации и вредоносной активности ботов.

Что на самом деле представляет собой бот-трафик?

Под бот-трафиком подразумеваются запросы, выполняемые автоматизированным программным обеспечением, а не человеком, использующим браузер. Эти программы отправляют запросы к веб-страницам, изображениям, скриптам или API так же, как это делал бы браузер посетителя, но эта активность происходит без прямого взаимодействия с человеком.

С технической точки зрения, сервер часто получает запросы одного и того же типа. Разница заключается в способе генерации запроса и его поведении с течением времени.

Автоматизация не является чем-то необычным или по своей сути вредным. Большая часть интернета зависит от автоматизированных систем, которые постоянно сканируют веб-сайты, проверяют время безотказной работы, подтверждают производительность или получают данные для легитимных сервисов. Поисковые системы используют ботов для обнаружения и индексации нового контента, инструменты мониторинга регулярно проверяют доступность, а различные интеграции запрашивают API для синхронизации приложений.

Важно отметить, что слово «бот» описывает способ генерации трафика, а не причину его возникновения. Некоторые автоматизированные системы обеспечивают прозрачность и безопасность, в то время как другие пытаются использовать уязвимости, собирать контент или перегружать инфраструктуру. Поскольку намерения ботов сильно различаются, выявление и классификация их поведения гораздо полезнее, чем рассмотрение всего автоматизированного трафика как единой категории.

Три типа трафика, поступающего на сайт

Часто веб-трафик делится на две простые категории: «человеческий» и «ботовый», но в действительности большинство запросов попадают в три практические категории:

- реальные посетители,

- полезные боты,

- вредоносные боты.

Понимание этого различия упрощает интерпретацию аналитики, управление ресурсами и применение соответствующих мер безопасности без нарушения законной деятельности.

Как мы уже упоминали ранее, в отчете Imperva Bad Bot Report отмечалось, что автоматизированный трафик составляет более половины всех веб-запросов в мире, причем значительная его часть классифицируется либо как полезная автоматизация, либо как вредоносная активность ботов. При объединении этих различных источников объем трафика сам по себе мало что говорит о спросе или вовлеченности пользователей.

Цель состоит не в том, чтобы блокировать что-либо, что выглядит автоматизированным, а в том, чтобы определить, какие запросы поступают от реальных людей, какие поддерживают функциональность и видимость сайта, а какие создают риски или ненужную нагрузку.

Анализ моделей поведения, характеристик запросов и источников трафика может обеспечить необходимую ясность для внедрения эффективной автоматизации, защиты от вредоносных действий и оценки производительности с использованием данных, отражающих реальное поведение пользователей.

Реальные посетители: как выглядит поток людей

Поток посетителей, как правило, имеет нерегулярный и непредсказуемый характер. Реальные посетители перемещаются по сайтам по-разному: они выбирают различные пути навигации, задерживаются на определенных страницах, прокручивают страницу на разную глубину и проводят непостоянное количество времени, прежде чем совершить следующее действие. Даже когда несколько посетителей приходят из одной и той же кампании или региона, их поведение редко повторяется в идентичной последовательности.

Подлинные пользовательские сессии также включают реалистичные модели взаимодействия. Такие действия, как поиск на сайте, отправка форм, воспроизведение медиафайлов, вход в учетную запись или активность в электронной коммерции, обычно происходят в логической последовательности, а не в идеально синхронизированных или повторяющихся интервалах. Время между запросами естественным образом меняется, отражая то, как люди читают, думают и принимают решения о дальнейших действиях.

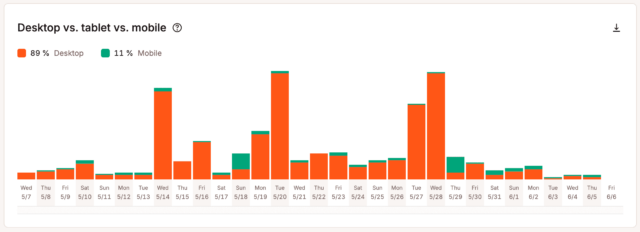

Разнообразие устройств — еще один важный показатель человеческого трафика. Реальные посетители заходят на сайт, используя широкий спектр браузеров, операционных систем, скоростей соединения и размеров экранов. Даже концентрированный географический трафик демонстрирует вариативность в зависимости от устройств и конфигураций, создавая распределение, которое редко выглядит равномерным.

В то же время идентификация трафика, состоящего из людей, не всегда проста. Защита конфиденциальности, блокировщики рекламы, уровни кэширования и общие сетевые среды могут маскировать определенные сигналы или создавать впечатление, что разные пользователи похожи друг на друга на уровне инфраструктуры.

По этой причине классификация трафика наиболее эффективна, когда оцениваются несколько показателей, включая упомянутые нами модели поведения, характеристики сессий, разнообразие устройств и сигналы взаимодействия, а не на основе какого-либо одного показателя.

Полезные боты: автоматизация, которая поддерживает сайт

Не весь автоматизированный трафик стоит блокировать. Многие боты играют важную роль в обеспечении видимости, мониторинга и корректного функционирования вашего сайта.

Поисковые роботы

Это один из важнейших примеров. Эти боты систематически запрашивают страницы для поиска нового контента, оценки изменений и обновления поисковых индексов.

Их поведение, как правило, структурировано и предсказуемо: они методично переходят по ссылкам и соблюдают директивы сканирования, определенные в файле robots.txt. Предотвращение доступа этих поисковых роботов к вашему сайту может снизить видимость в результатах поиска и замедлить появление новых страниц.

Услуги мониторинга и тестирования бесперебойной работы

Другие эффективные методы автоматизации сосредоточены на мониторинге и поддержании работоспособности. Инструменты мониторинга доступности, средства проверки производительности и сервисы синтетического тестирования регулярно отправляют запросы для подтверждения доступности, измерения времени загрузки и раннего выявления сбоев.

SEO-инструменты и инструменты валидации

Аналогичным образом, инструменты SEO, доступности и проверки данных сканируют страницы для выявления технических проблем, неработающих ссылок или нарушений соответствия требованиям, которые в противном случае могли бы остаться незамеченными.

Как правило, полезные боты четко заявляют о своем присутствии. Зачастую они идентифицируют себя с помощью согласованных строк пользовательского агента, работают в рамках установленных лимитов запросов и следуют опубликованным правилам сканирования.

Поскольку эти системы поддерживают индексирование, мониторинг и интеграцию, их блокировка без проверки может нарушить рабочие процессы мониторинга, снизить обнаруживаемость или привести к сбоям в работе сервисов, зависящих от запланированных автоматизированных запросов.

Вредоносные боты: трафик, создающий риски или потери

Вредоносные боты — это автоматизированные системы, предназначенные для эксплуатации веб-сайтов, извлечения данных в больших масштабах или потребления ресурсов инфраструктуры без какой-либо пользы. В отличие от полезной автоматизации, эти боты обычно пытаются скрыть свою личность, игнорируют правила сканирования и генерируют шаблоны запросов, предназначенные для обхода базовых средств защиты.

Боты для подбора учетных данных и перебора паролей

Это одни из самых распространенных угроз. Эти системы неоднократно атакуют точки входа в систему, быстро проверяя большие списки украденных имен пользователей и паролей в попытке получить несанкционированный доступ. Даже в случае неудачи, большой объем запросов может увеличить нагрузку на сервер и замедлить время отклика для легитимных пользователей.

Сканеры уязвимостей и программы для сбора данных

Другие вредоносные автоматизированные системы сосредоточены на обнаружении и эксплуатации уязвимостей. Сканеры уязвимостей исследуют известные каталоги, файлы конфигурации и программные конечные точки в поисках устаревших компонентов или неправильных настроек, которые могут быть использованы злоумышленниками. Агрессивные боты для сбора данных также могут запрашивать большие объемы страниц или медиафайлов для копирования контента с целью его повторной публикации на других ресурсах, потребляя при этом пропускную способность и ресурсы инфраструктуры.

DDoS-атаки

Некоторые атаки направлены исключительно на нарушение работы системы, а не на получение доступа. Кампании по перегрузке трафика и атакам типа «отказ в обслуживании» направлены на перегрузку серверов или уровней приложений за счет постоянных всплесков запросов, что приводит к снижению производительности или временной недоступности сервисов.

Помимо непосредственного влияния на производительность, вредоносный бот-трафик может искажать аналитику и ухудшать пользовательский опыт для реальных посетителей, если его не контролировать.

Как отличить людей от полезных ботов и вредоносных ботов

Различение реальных посетителей, полезной автоматизации и вредоносных ботов в большей степени зависит не столько от какого-либо одного идентификатора, сколько от распознавания устойчивых моделей поведения по множеству сигналов.

При совместной оценке эти показатели позволяют легче определить, отражает ли трафик активность человека, законную автоматизацию или потенциально неправомерные запросы.

Частота и время запросов

Посетители-люди отправляют запросы с нерегулярными интервалами, читая, прокручивая и перемещаясь по сайту. А автоматизированные системы, как правило, запрашивают страницы с очень высокой скоростью или быстрыми всплесками, которые человеку было бы трудно воспроизвести. Чрезвычайно высокая частота запросов из одного источника или идеально синхронизированные интервалы обычно указывают на скриптовую активность.

Строки пользовательского агента

Легитимные боты, как правило, четко и последовательно идентифицируют себя. А вредоносные боты часто меняют или подделывают пользовательские агенты, пытаясь выглядеть как люди. Сравнение заявлений пользовательских агентов с наблюдаемым поведением помогает выявить несоответствия, указывающие на автоматизацию.

Репутация IP-адреса и владение сетью

Трафик, исходящий из известных сетей облачного хостинга, прокси-сервисов или ранее помеченных адресов, может указывать на автоматизированные системы, а не на реальных людей. Базы данных репутации и инструменты безопасности классифицируют эти сети на основе прошлой активности и помогают быстрее выявлять подозрительные источники.

Географические закономерности распространения

Внезапное увеличение трафика из неожиданных регионов, особенно в сочетании с идентичным поведением запросов, может указывать на скоординированную деятельность ботов, а не на рост аудитории.

Соблюдайте ограничения, установленные файлом robots.txt и правилами сканирования

Если вы заметили это, то это явный признак настоящей автоматизации. Полезные боты, как правило, следуют опубликованным правилам сканирования и работают в разумных пределах запросов, в то время как вредоносные боты обычно игнорируют эти директивы и продолжают запрашивать ограниченные пути или файлы.

Поскольку ни один из этих сигналов сам по себе не дает полного ответа, эффективная классификация достигается путем анализа нескольких показателей в совокупности. Со временем эти объединенные закономерности создают надежную картину того, представляет ли входящий трафик реальных пользователей, полезную автоматизацию или активность, требующую фильтрации или смягчения последствий.

Где анализировать бот-трафик?

Для понимания активности ботов необходима прозрачность на нескольких уровнях вашей хостинговой и инфраструктуры. Ни один инструмент сам по себе не дает полной картины, поэтому сочетание аналитики, логов и панелей мониторинга безопасности позволяет получить гораздо более надежные данные. Давайте рассмотрим каждый из них.

Аналитические платформы предоставляют отправную точку на высоком уровне

Резкие скачки трафика без соответствующей активности, внезапные географические аномалии или необычное распределение устройств часто указывают на автоматизированную активность. Хотя аналитические инструменты не всегда точно классифицируют ботов, они помогают выявить закономерности, указывающие на необходимость более глубокого расследования. Даже простые плагины, такие как Jetpack, могут в этом помочь.

Журналы сервера и доступа предоставляют наиболее подробное представление о поведении запросов

Журналы содержат информацию о частоте запросов, кодах ответов, строках пользовательских агентов, IP-адресах и используемых путях, что позволяет выявлять повторяющиеся шаблоны сканирования, попытки входа в систему или методы сбора данных, которые в противном случае остались бы скрытыми в агрегированных аналитических данных.

Панели мониторинга CDN обеспечивают дополнительный уровень прозрачности

Панели мониторинга CDN отображают закономерности трафика на границе сети до того, как запросы достигнут вашего исходного сервера. Эти панели часто выделяют всплески трафика, региональные аномалии или повторяющиеся автоматизированные запросы, которые фильтруются или ограничиваются скоростью на вышестоящем сервере. Это помогает обнаруживать атаки гораздо раньше, чем это было бы возможно в противном случае.

Межсетевые экраны и инструменты WAF обеспечивают анализ данных в режиме реального времени

Межсетевые экраны позволяют в режиме реального времени узнавать о заблокированных, проверяемых или подозрительных запросах. Анализ журналов межсетевого экрана может показать, какие источники трафика запускают правила безопасности и необходимы ли корректировки для уменьшения количества ложных срабатываний или усиления защиты.

Платформы управляемого хостинга упрощают этот процесс, объединяя несколько источников данных. Например, среды, интегрирующие аналитику на уровне CDN, мониторинг брандмауэра и журналы доступа в единую панель управления, упрощают сопоставление подозрительного поведения на разных уровнях.

Как бот-трафик искажает аналитику и процесс принятия решений

Когда автоматизированные запросы смешиваются с реальными посещениями, аналитические данные начинают отражать активность, не соответствующую интересу аудитории. Количество просмотров страниц и сессий может стабильно расти, даже если фактическое вовлечение, конверсии или доход остаются неизменными. Без разделения автоматизированного трафика и посещений, совершаемых пользователями, вы можете интерпретировать завышенные показатели трафика как рост и принимать стратегические решения на основе вводящих в заблуждение сигналов.

Показатели вовлеченности становятся особенно ненадежными. Боты часто генерируют сессии с крайне короткой продолжительностью, немедленными выходами или повторными запросами страниц, что может искусственно завышать или занижать показатели отказов и времени, проведенного на странице. В некоторых случаях боты для сбора данных многократно запрашивают определенные страницы, создавая впечатление, что определенный контент работает гораздо лучше, чем на самом деле, среди реальных пользователей.

Географические данные, данные об устройствах и реферальных ссылках также могут искажаться. Автоматизированный трафик часто поступает из центров обработки данных, прокси-сетей или концентрированных регионов, которые не соответствуют фактической клиентской базе сайта. Когда эти сессии включаются в отчеты, маркетинговые команды могут инвестировать в неправильные регионы, оптимизировать контент с учетом неверных тенденций использования устройств или неправильно интерпретировать эффективность кампаний.

Со временем эти неточности влияют на отчетность, планирование производительности, решения о масштабировании инфраструктуры и маркетинговые инвестиции. Все эти аспекты зависят от анализа трафика для прогнозирования спроса. Если значительная часть этого трафика состоит из автоматизированных запросов, компании рискуют переоценить рост, неэффективно распределять ресурсы или упустить из виду поведение пользователей, требующее внимания.

Рекомендации по управлению различными типами трафика

Управление современным веб-трафиком требует сбалансированного подхода, который защищает производительность сайта, не мешая при этом легитимной автоматизации или реальным пользователям. Вместо того чтобы пытаться блокировать все, что выглядит автоматизированным, цель состоит в применении политик, соответствующих поведению и намерениям каждого типа трафика.

Приоритет отдается пользовательскому опыту

Оптимизируйте производительность, доступность и удобство использования, чтобы легитимные посетители могли быстро и надежно получать доступ к контенту даже во время пиковых нагрузок. Быстрая загрузка страниц, стабильная инфраструктура и отказоустойчивое кэширование помогают гарантировать, что легитимные пользователи не пострадают при увеличении автоматизированного трафика.

Разрешите и отслеживайте полезную автоматизацию

Поисковые роботы, системы мониторинга доступности и инструменты проверки должны быть явно разрешены там, где это уместно, чтобы индексирование, мониторинг и интеграции продолжали корректно функционировать. Периодический анализ поведения роботов помогает убедиться в том, что легитимные боты работают в разумных пределах.

Применяйте защиту от вредоносного трафика на основе анализа поведения пользователей

Ограничения скорости, проверки безопасности и целевые правила блокировки наиболее эффективны, когда срабатывают на основе подозрительных шаблонов запросов, а не на основе статических предположений о диапазонах IP-адресов или пользовательских агентах. Контроль поведения снижает вероятность блокировки легитимных сервисов, одновременно предотвращая противоправные действия.

Регулярно пересматривайте и корректируйте политику

По мере роста сайтов, запуска рекламных кампаний и взаимодействия новых автоматизированных систем с контентом, характер трафика меняется. Периодический пересмотр правил брандмауэра, ограничений скорости и оповещений мониторинга помогает гарантировать, что защита соответствует текущему поведению трафика, а не основана на устаревших предположениях.

Используйте информацию об источниках трафика для принятия более обоснованных решений

Объем трафика сам по себе редко дает полное представление о производительности веб-сайта. Когда данные аналитики разделены на посещения пользователей, полезную автоматизированную обработку и вредоносную активность ботов, они становятся гораздо более значимыми и пригодными для принятия решений.

Четкая сегментация трафика позволяет командам измерять реальный рост аудитории, понимать модели вовлеченности и оценивать эффективность маркетинга без искажения результатов из-за автоматизированного шума.

Более точная классификация трафика также улучшает принятие оперативных решений. Планирование производительности, масштабирование инфраструктуры и стратегии безопасности легче согласовываются с реальным спросом, когда автоматизированные запросы измеряются и обрабатываются независимо.

Источник: kinsta.com

Комментарии к записи: 0